2月井喷!中国AI调用量首超美国,四款大模型霸榜全球前五,国产算力需求正经历指数级增长

全球最大AI模型API聚合平台OpenRouter数据显示,2026年2月,中国AI模型调用量三周大涨127%,首次超越美国,且全球前五中占四席。Token正从“流量”变为AI时代“燃料”,AI服务商业模式向“燃料+成果”演进,未来定价将走向定制化和灵活化。中国模型厂商,正凭借快速迭代和成本优势占领全球市场,国产算力需求正经历指数级增长。

每经记者 宋欣悦 每经编辑 肖勇,王嘉琦,高涵

2月,中国AI的模型调用量爆发式增长,首次超过美国。

全球最大的AI模型API聚合平台OpenRouter数据显示,9日~15日这周,中国模型以4.12万亿Token的调用量,首次超过同期美国模型的2.94万亿Token。

16日~22日这周,中国模型的周调用量进一步冲高至5.16万亿Token,三周大涨127%,而同期美国模型调用量跌至2.7万亿Token。与此同时,全球调用量排名前五的模型中,中国模型占据四席,这股强大的增长动能,并非依赖单一爆款产品,而是中国AI厂商集群式崛起。

Token是AI模型处理文本的最小单位。相比用户数,Token调用量是更能真实反映AI模型使用强度、用户粘性及商业价值的关键指标。

中国模型厂商,正凭借快速迭代和成本优势占领全球市场,国产算力需求正经历指数级增长。

榜单洗牌:中国Token调用量首超美国,四款大模型霸榜

OpenRouter平台,汇聚了全球数百种大语言模型,拥有超过500万开发者用户,是目前全球最大的AI模型API聚合平台。因此,其API调用量数据被视为洞察全球AI应用落地趋势最真实的“晴雨表”,因为它直接反映了开发者“用脚投票”的选择,体现了模型在实际应用中的受欢迎程度和竞争力。

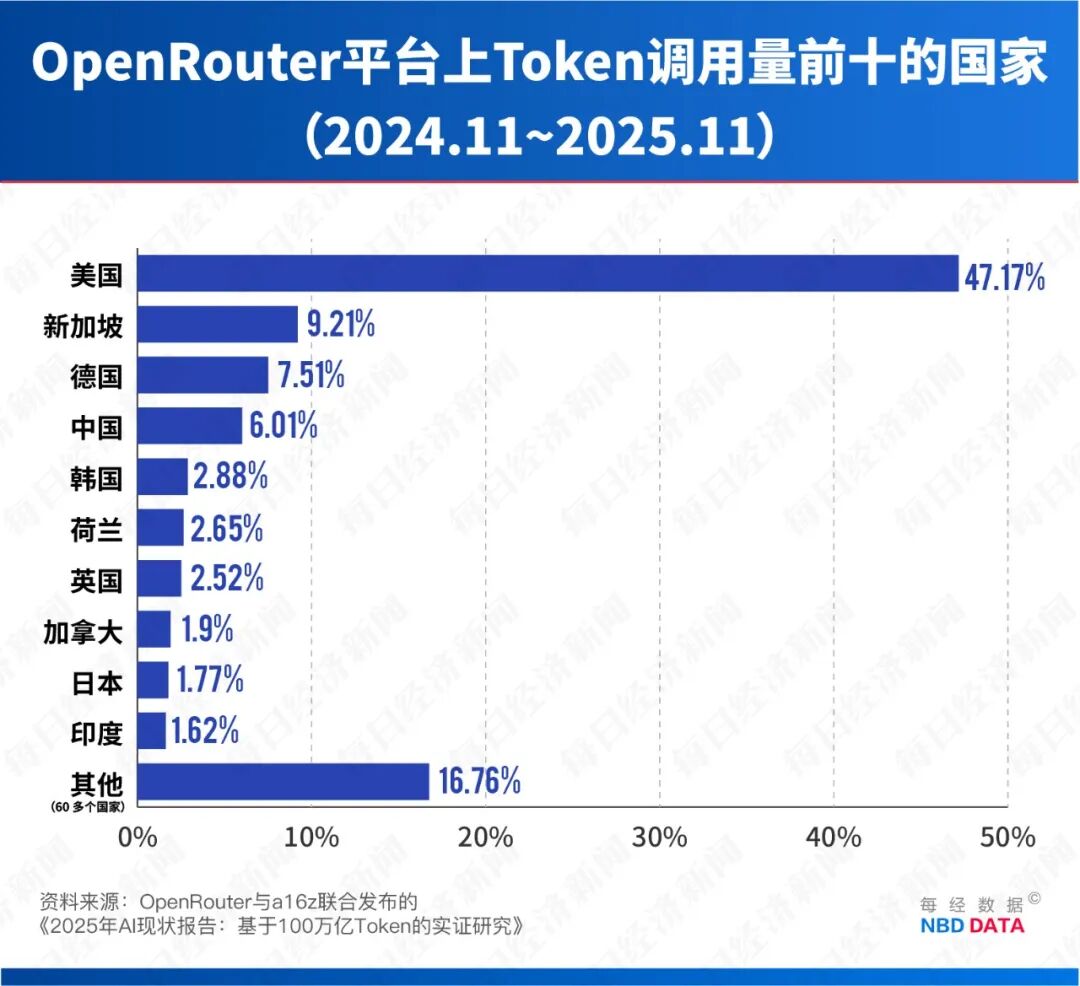

值得注意的是,该平台的用户主要由海外开发者构成,其中美国用户占比高达47.17%,而中国开发者仅占6.01%,这使得其榜单数据更能客观反映中国AI模型在全球范围内的真实吸引力。

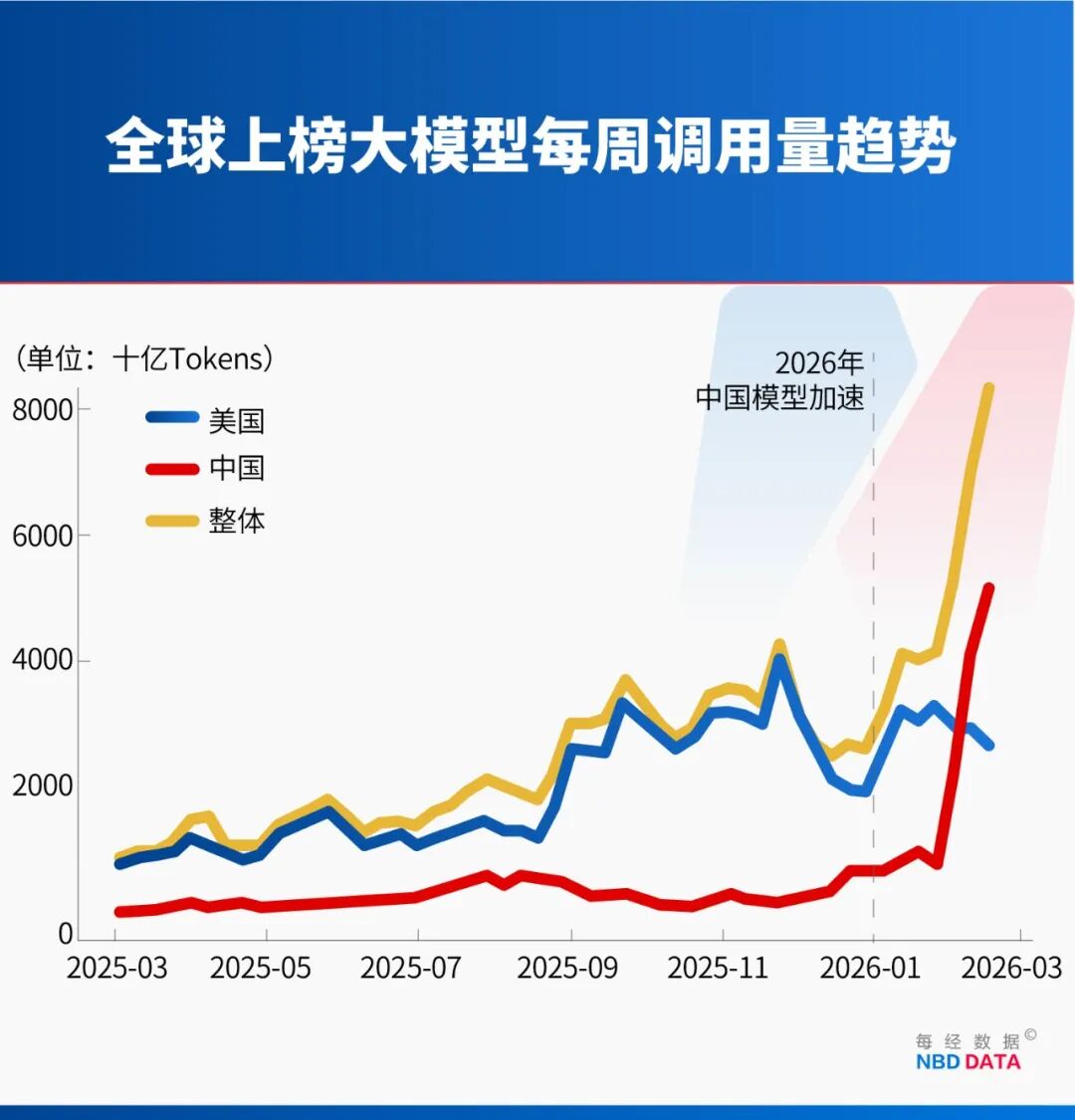

《每日经济新闻》记者(以下简称每经记者)梳理OpenRouter数据发现,全球大模型Token调用量在过去一年经历了惊人的爆发式增长。2025年3月3日至9日当周,该平台前十大模型的周调用量仅为1.24万亿Token。而到2026年2月中旬,这一数字已飙升至13.95万亿Token,短短不到一年时间增长了超过10倍。

2025年,美国模型是市场增长主要动力,其Token周调用量一度占据平台前十大模型总量的近七成,而同期的中国模型占比则不到两成。然而,进入2026年,美国模型的增速开始显露疲态,而中国模型则开启了“狂飙”模式。

数据显示,2026年2月的第一周(2日至8日),中国模型的周调用量已跃升至2.27万亿Token,发出了强烈的追击信号。

仅仅一周之后,在2月9日至15日当周,中国模型便以4.12万亿Token的惊人调用量,正式超越了同期美国模型的2.94万亿Token,实现了历史性赶超。

这股势头并未就此停止,到2月16日当周,中国模型的周调用量更是冲高至5.16万亿Token,三周时间调用量增长127%,将领先优势进一步扩大。

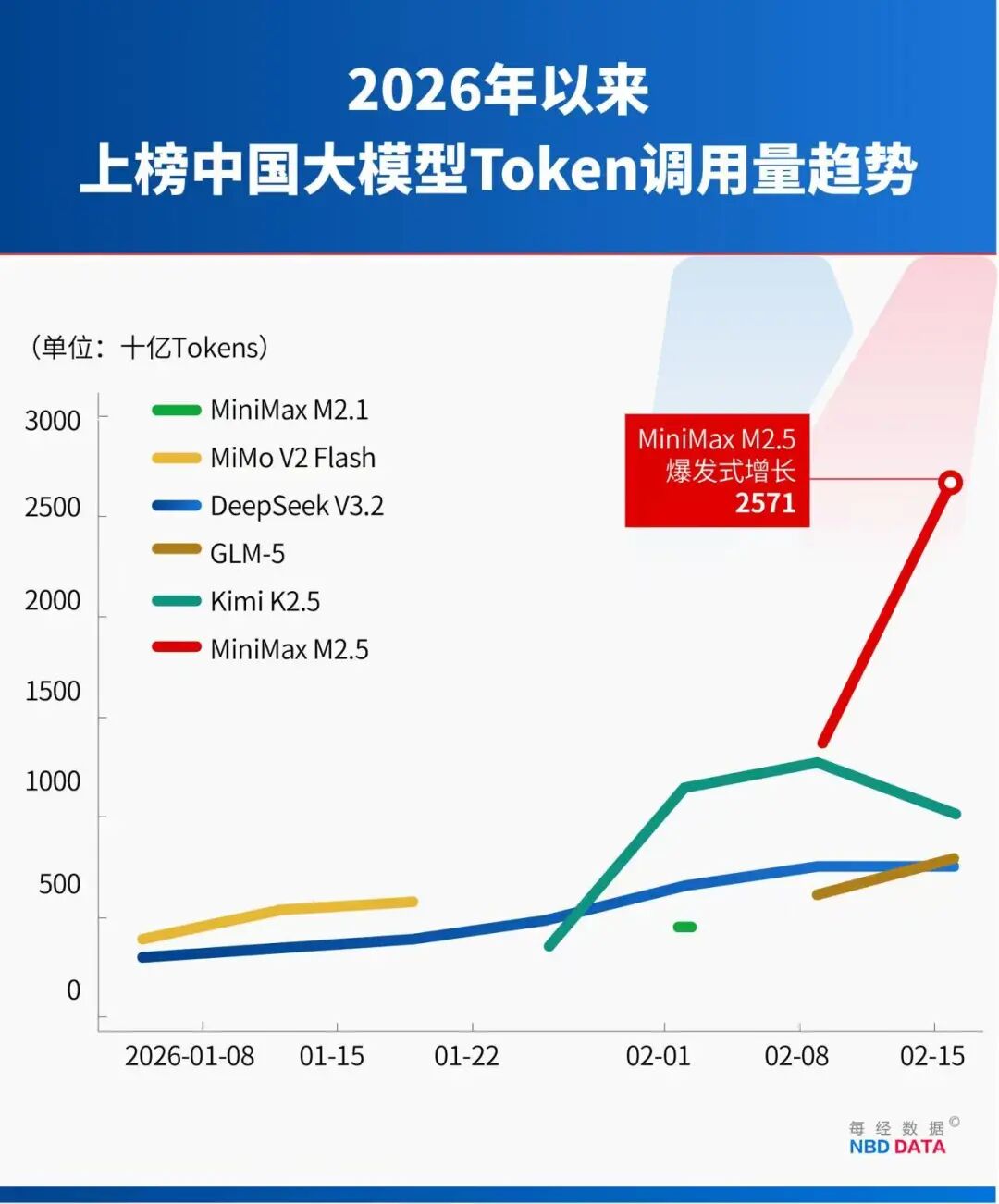

这股强大的增长动能,并非依赖单一爆款产品,而是中国AI厂商集群式崛起。

2026年2月16日至22日的周榜单显示,平台调用量排名前五的模型中,有四款来自中国厂商,分别为MiniMax的M2.5、月之暗面的Kimi K2.5、智谱的GLM-5以及DeepSeek的V3.2。这四款模型合计贡献了Top5总调用量的85.7%。

具体来看,MiniMax于2026年2月13日发布的M2.5模型,上线不足一周便迅速登顶周调用量榜首。在2月9日至15日当周,OpenRouter平台总调用量激增的3.21万亿Token中,仅M2.5这一款模型就贡献了1.44万亿Token的惊人增量。

月之暗面于1月27日发布的Kimi K2.5模型,凭借其原生的多模态架构和强大的Agent并行处理能力,调用量实现了连续跳涨。该模型能调度多达100个“Agent分身”并行工作,将复杂任务处理效率提升3到10倍。据媒体报道,Kimi在发布Kimi K2.5后不到一个月的累计收入,已超过其2025年全年的总收入,增长主要由全球付费用户及API调用量大涨共同推动。

智谱的旗舰模型GLM-5自2月12日发布后,凭借其200K的超长上下文窗口和对长程Agent任务的深度优化,用户规模迎来高速增长,其调用量在上线次周便增长至0.8万亿Token。

过去一年,阿里千问虽单个模型上榜频次不高,但a16z与OpenRouter联合发布的报告显示,其全系列模型总Token调用量以5.59万亿位居全球第二,仅次于DeepSeek(14.37万亿)。

咨询公司弗若斯特沙利文(Frost & Sullivan)报告显示,在中国大模型B端市场,2025年下半年,千问(Qwen)系列模型的日均Token调用量占比32.1%位列第一,相较上半年的17.7%几乎翻倍,相比字节豆包(21.3%)、DeepSeek(18.4%)领先优势扩大。

对于中国AI大模型的格局,上海财经大学特聘教授胡延平在接受每经记者采访时提出了“AI中国团”的说法。

他认为,产业市场集中度并非越高越好,有多家头部企业形成宽广的技术产业群落,而不是少数两三家寡头,对于竞争创新和人才生态建设是好事,也有利于在中美AI竞争中形成集群优势。

知名风险投资机构Andreessen Horowitz(a16z)的合伙人Martin Casado观察到,如今在硅谷寻求融资的AI初创公司中,其路演核心模型高达80%使用中国的开源模型。

竞争力:成本不到美国AI的1/10,中国Token为何便宜?

中国模型之所以能在短时间内席卷全球开发者,除了性能上比肩甚至超越国际顶尖模型外,其极具竞争力的成本是另一个无可争议的核心优势。

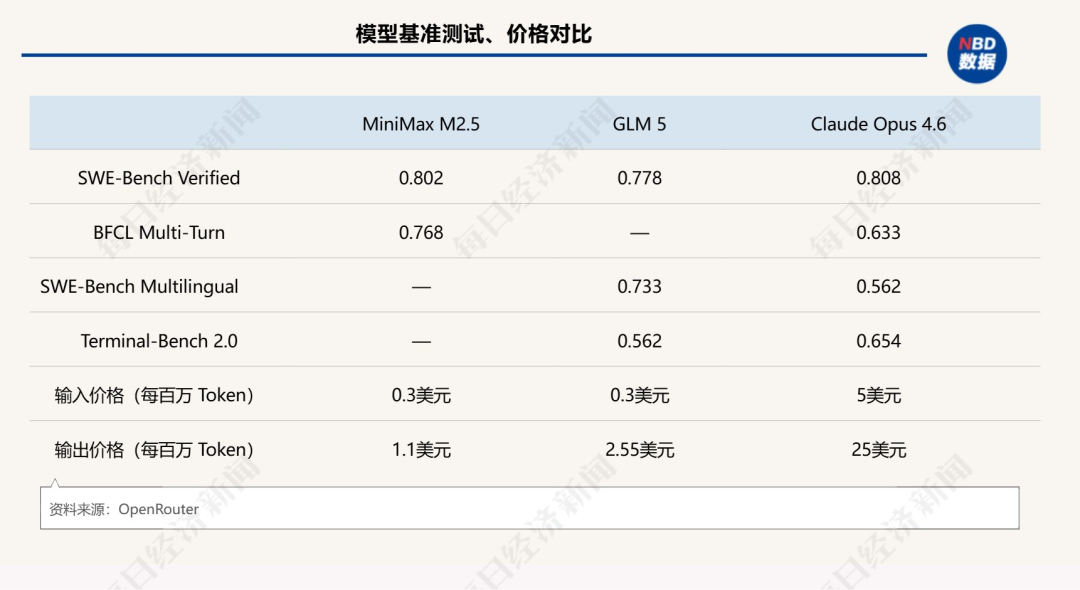

以OpenRouter平台公示的价格为例,中国模型的成本优势一目了然。

在模型处理输入信息(Input)的环节,MiniMax的M2.5与智谱的GLM-5,其价格均为0.3美元每百万Token。作为对比,海外主流的对标产品Claude Opus4.6的价格则高达5美元/百万Token,是中国这两款模型的约16.7倍。

在模型生成内容(Output)的环节,成本差异更为悬殊。MiniMax M2.5的输出价格为1.1美元/百万Token,智谱GLM-5为2.55美元/百万Token,而Claude Opus4.6的价格则飙升至25美元/百万Token,分别是前两者的约22.7倍和9.8倍。

如此巨大的成本差距,直接决定了开发者在选择API时的经济考量。

这种显著的成本差异,首先源于算法层面的架构创新。

弗若斯特沙利文中国总监李庆在接受每经记者采访时分析指出,以“混合专家(Mixture-of-Experts, MoE)”架构为代表的技术路线,是中国模型能够大幅降低推理成本的核心原因之一。目前,包括榜单上的DeepSeek、阿里巴巴的通义千问3.5-Plus等模型,都已广泛采用了MoE架构。

MoE架构的巧妙之处在于,它将一个巨大的模型拆分为多个相对较小的“专家网络”和一个“门控网络”。尽管模型的总参数量可能非常庞大(如拥有数千亿参数),从而保证了其“知识储备”和能力上限,但在实际处理一个任务时,门控网络会智能地判断该任务的性质,并只激活(调用)其中一小部分最相关的专家网络参与计算。

这种“按需激活”而非“全体动员”的模式,相较于传统的稠密模型(每次计算都调用全部参数),极大地减少了计算量和对硬件资源的需求。数据显示,采用MoE架构可以直接让推理时的显存占用降低60%,推理吞吐量(单位时间内处理的Token数量)提升高达19倍。这种从技术源头上实现的降本增效,是其成本优势的根本来源。

除了算法架构的革新,中国AI厂商还在积极探索“垂直整合”的路径,以进一步压缩每一个Token背后的成本。这条路径的核心思想,是将上层的模型算法、中层的云计算基础设施和底层的AI芯片进行深度的、一体化的协同设计与优化,从而解决软硬件之间的适配痛点,榨干每一分算力。

李庆以阿里巴巴的“通义-云-芯”体系为例进行说明,这种从上到下的垂直整合模式,能够通过极致的算力调度算法,实现对底层硬件资源的最高效利用,从而大幅降低了AI服务背后的基础设施成本。这种系统级的优化,使得Token的生成成本得以进一步降低。

摩根大通在其研报中对中国市场做出极为乐观的预测,预计从2025年到2030年,中国Token消耗量的年复合增长率将达到惊人的330%,在短短5年间实现370倍的增长。

价值质变:Token正从互联网“流量”,成为AI时代的“燃料”

图片来源:AI生成

Token消耗量的指数级攀升,表面看是用户规模与使用时长的增长,但其背后更深层次的驱动力,是用户对AI使用模式的根本性转变。AI的角色正在从一个提供简单信息、进行日常闲聊的“问答工具”,进化为能够深度参与工作流、处理复杂任务的“生产力工具”。

国联民生证券在近期发布的研报中,提出了“Token通胀”这一概念。这并非指Token本身变贵,而是指在单位时间内、单位用户的Token消耗结构性上升。报告将这一现象归因于三大核心趋势。

首先,用户的核心需求正在从浅层的“问答”转向深度的“干活”,即越来越多地利用AI来重构代码、改写文件、生成文档和跑测试。编程场景天然具有“长上下文、多轮迭代、大量输出”的特征,会大量消耗Token。

其次,AI Agent技术的兴起和普及,放大了Token的消耗。Agent会主动规划、检索、执行、反思,多次调用模型,Token消耗自然按步骤累加。

最后是推理强度上升。更多深度思考、更长链路推理会显著提高输出与中间过程的Token消耗。但对开发者而言,这往往带来更高成功率与更少返工,用户反而愿意“增加Token投入来换取效率”。

这一系列转变,意味着Token不是传统互联网时代边际成本几乎为零的“流量”,而是执行生产任务时必不可少的“燃料”。

这一趋势与全球顶尖芯片制造商的判断不谋而合。英伟达CEO黄仁勋在2月26日的业绩电话会上,反复向市场强调一个核心观点:“计算即收入”“推理即收入”。他指出,没有算力,就无法生成Token;没有Token,就无法带来收入增长。在AI时代,推理性能直接决定了客户的收入能力,而推理的核心,正是高效地生成可被商业化的Token。在全球数据中心电力瓶颈日益凸显的今天,“性能/瓦特”(Performance per Watt)已成为衡量AI服务效率与收入能力的关键指标。

李庆向每经记者表示,AI服务的商业模式正从过去单纯的“按量计费”,向“燃料+成果”的混合模式演进。一方面,作为“燃料”的Token,其单价会随着技术进步和规模效应持续下降;另一方面,随着AI从“问答”工具向“干活”的生产力工具转变,企业将更愿意为直接的“成果”付费,这将催生出更多基于订阅制的商业模式。

李庆还预测,未来AI服务的定价将不可避免地走向高度定制化和灵活化。她表示,Agent时代的到来意味着任务的复杂度千差万别,单一的定价模式将无法覆盖所有商业需求。未来,计算消耗、调用频次、任务是否涉及多步推理或规划等高成本操作,都将成为影响定价的因素,一个多维度、动态的定价体系将成为主流。

记者|宋欣悦

编辑|肖勇 王嘉琦 高涵

视觉|刘青彦

排版|高涵

统筹|易启江

每经头条

每经头条

每经热评

每经热评

川公网安备 51019002002025号

川公网安备 51019002002025号